Wer in den letzten Jahren in den sozialen Medien aktiv war, hat vielleicht mitbekommen, dass neue Smartphones oft schlechtere Fotos machen als die alten. Egal ob auf Instagram oder TikTok – Anleitungen wie „Wie man die schlechte Kameraqualität des iPhones verbessert“ oder „Wie man die automatische Bildbearbeitung des iPhones deaktiviert“ sind keine Seltenheit.

Qualität ist jedoch extrem subjektiv. Was genau stört die Leute also? Häufig wird bemängelt, dass die Bildvorschau in der Kamera-App nicht exakt dem Endergebnis entspricht. Dafür gibt es einen guten Grund, und um ihn zu erklären, müssen wir einen Blick in die Geschichte werfen.

Was bedeutet es, wenn ein Foto nicht nur digital, sondern auch computergeneriert ist?

Traditionell verwendeten Fotografen Filmkameras, die kaum oder gar keine digitale Eingabemöglichkeit boten. Licht fiel durch ein Objektiv, traf kurz auf einen Film, der anschließend manuell entwickelt wurde. Digitalkameras veränderten dies, indem sie anstelle von Film einen Sensor verwendeten. Auch hier trifft Licht auf den Sensor, doch anstatt das Bild chemisch und dauerhaft zu fixieren, berechnet ein winziger Chip, wie viel Licht jedem Pixel ausgesetzt ist, und wandelt diese Werte in einen Zahlenbereich um, aus dem später das Bild entsteht.

Das heißt, Digitalkameras haben schon immer eine Art von Berechnung durchgeführt. Der Begriff „Computational Photography“ wurde jedoch erst um 2016 allgemein bekannt, maßgeblich durch die Arbeit von Marc Levoy bei Google und seine Forschung an HDR-Algorithmen (High Dynamic Range) . Eine der größten Herausforderungen in der Fotografie ist die präzise Aufnahme von Bildern mit stark variierenden Lichtverhältnissen. Bei Kameras wird dies durch den Dynamikumfang gemessen, also den Helligkeitsbereich von den hellsten bis zu den dunkelsten Bereichen, den eine Kamera in einer einzigen Aufnahme erfassen kann. Ein HDR-Bild ist demnach ein Bild, das so bearbeitet wurde, dass es einen möglichst großen Dynamikumfang aufweist. Smartphones – und sogar herkömmliche Kameras – können zwar schon seit Längerem HDR-Fotos aufnehmen, doch Marc und sein Team entwickelten einen Algorithmus, der ab dem Öffnen der Kamera-App automatisch im Hintergrund Fotos aufnimmt. Sobald man den Auslöser betätigt, stoppt die Kamera die Aufnahme, nimmt die letzten Bilder auf und fügt sie zu einem einzigen „Superbild“ zusammen. Die Ergebnisse waren nicht nur offensichtlich, sondern wurden allgemein für ihre höhere Detailgenauigkeit, das geringere Rauschen und den höheren Dynamikumfang gelobt. Da diese Bearbeitung erst nach der Aufnahme des Fotos erfolgte, entsprach das Sucherbild nicht exakt dem endgültigen Ergebnis, sondern diente eher als Schätzung.

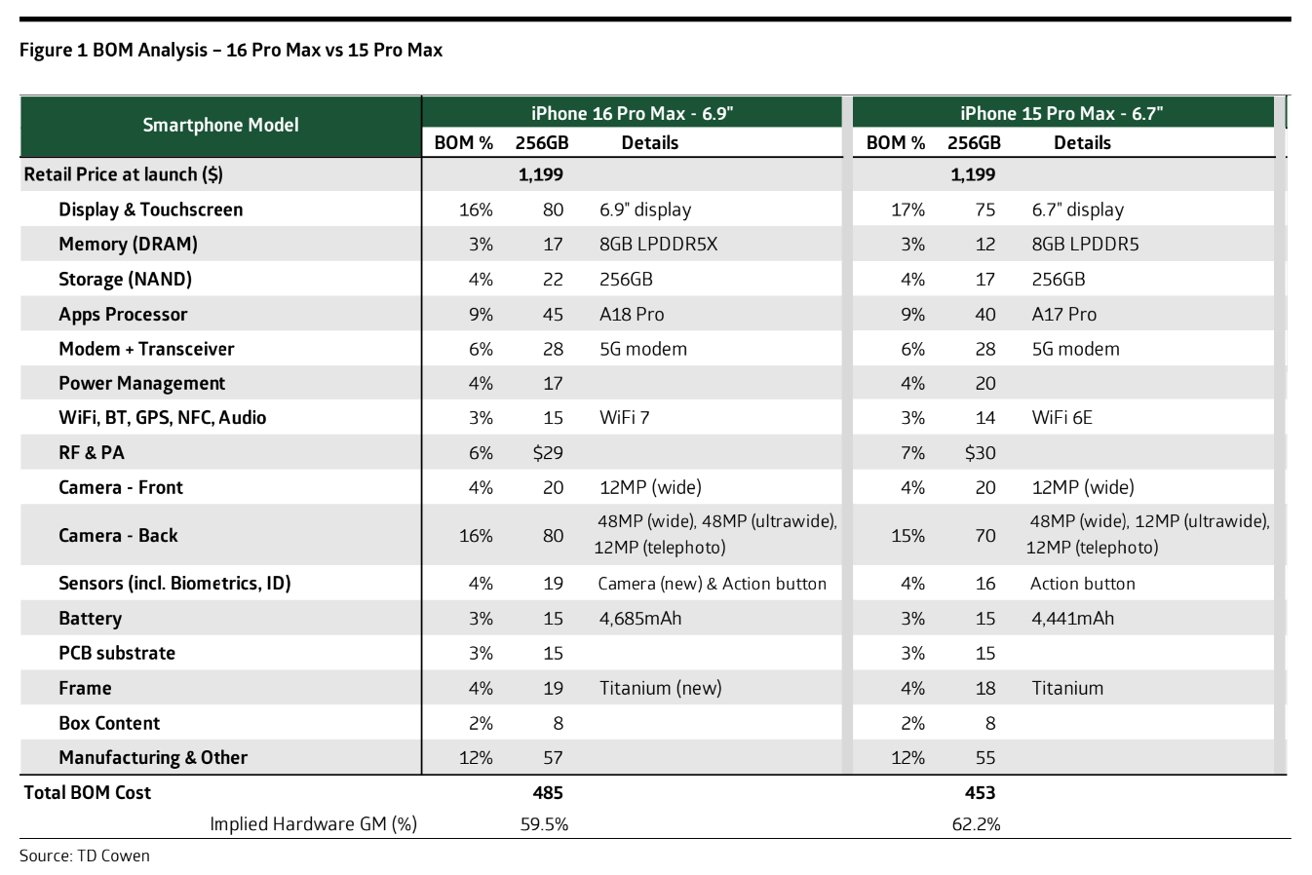

Man könnte sich fragen, warum diese aufwendige Bildbearbeitung nötig ist, wo doch traditionelle Kamerahersteller wie Sony und Canon mit weniger Software bessere Ergebnisse erzielen könnten. Nun, das liegt daran, dass Smartphone-Kameras vergleichsweise günstig sind. Man mag die Idee, ein Gerät für über tausend Euro als „günstig“ zu bezeichnen, belächeln, aber bedenken Sie, dass die Kamera bei Weitem nicht die teuerste Komponente Ihres Smartphones ist. Laut TD Cowen machen die Kamerasensoren eines iPhone 16 weniger als 20 % der Materialkosten aus – und das umfasst alle drei Kameras, nicht nur die Hauptkamera.

Vergleich der Stücklisten von iPhone 16 und 15.

(Bild von TD Cowen und Apple Insider.)

Im Vergleich dazu sind herkömmliche, auf einen einzigen Zweck ausgelegte Kameras und Objektive leicht Tausende von Dollar kosten können, und Sie werden feststellen, dass der Kamerasensor Ihres Handys unglaublich klein und tatsächlich billig ist.

Um die Lücke zwischen herkömmlichen Kameras und Handykameras zu schließen, mussten die Hersteller auf Tricks wie die bereits erwähnte HDR-Zusammenführung, den Nachtmodus, dynamische Farbtemperatureinstellungen usw. zurückgreifen. Doch die Frage bleibt: Warum hat sich die Meinung, dass Fotos immer schlechter werden, so plötzlich verbreitet?

Zwischen Baum und Borke gefangen.

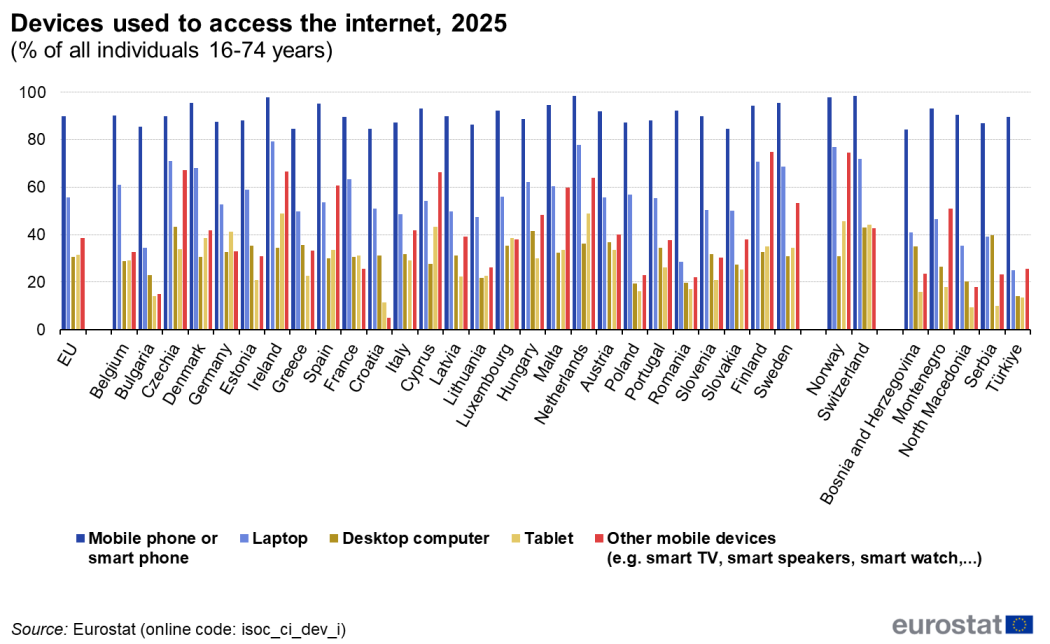

Ein entscheidender Faktor ist die Nutzerbasis. Wenn Sony eine High-End-Kamera entwickelt, hat das Unternehmen eine extrem kleine Zielgruppe im Blick: Menschen, denen Sony vertraut, dass sie den optimalen Umgang mit dem Produkt erlernen werden. Wenn Apple oder Google hingegen ein Smartphone auf den Markt bringen, müssen sie eine breite Zielgruppe unterschiedlicher Kulturen, sozioökonomischer Schichten und Generationen ansprechen – kurzum: alle. Smartphones sind so weit verbreitet, dass laut einem Eurostat-Bericht … In vielen EU-Ländern nutzen nahezu 100 % der Personen im Alter von 16 bis 74 Jahren ein Mobiltelefon, um auf das Internet zuzugreifen.

Vergleichstabelle der Gerätetypen für den Internetzugang in der EU, gruppiert nach Ländern.

Das bedeutet, die Kamera Ihres Smartphones muss die beste sein – für einen 16-jährigen Schüler, der im Unterricht Fotos von der Tafel macht, für Ihre Großeltern, um ihren Urlaub festzuhalten, für Ihre Eltern, um Familienfotos an den Feiertagen zu machen, und schließlich für Sie selbst, um Ihren Alltag zu meistern. Sie muss jederzeit und überall funktionieren, selbst in schwierigen Situationen wie Gegenlichtaufnahmen oder Nachtaufnahmen.

Einfach ausgedrückt: Es ist unmöglich, eine so große Nutzergruppe umfassend zu schulen. Daher sind die Hersteller gezwungen, eine Kamera zu entwickeln, die auch dann das bestmögliche Foto liefert, wenn der Fotograf die Grundlagen der Fotografie nicht kennt. Dies ist nicht unbedingt ein schlechtes Ziel, sondern vielmehr ein demokratischer Weg, das Interesse an der Fotografie zu wecken.