Jeśli w ciągu ostatnich kilku lat aktywnie korzystałeś z mediów społecznościowych, mogłeś zauważyć, że Twój nowy telefon robi gorsze zdjęcia niż poprzedni. Niezależnie od tego, czy korzystasz z Instagrama, czy TikToka, z łatwością znajdziesz poradniki na temat „jak uniknąć złej jakości zdjęć w iPhonie” lub „jak wyłączyć automatyczną edycję zdjęć w iPhonie”.

Jednak „jakość” jest pojęciem niezwykle subiektywnym, więc co właściwie denerwuje ludzi? Częstą skargą jest to, że podgląd obrazu w aplikacji aparatu nie do końca odpowiada wynikowi końcowemu, ale jest ku temu dobry powód i aby go wyjaśnić, musimy cofnąć się do historii.

Co to znaczy, że zdjęcie jest nie tylko cyfrowe, ale i obliczeniowe?

Tradycyjnie fotografowie używali aparatów analogowych, które miały niewielki lub żaden cyfrowy wkład. Światło przechodziło przez obiektyw, na chwilę padało na kliszę, która następnie była wywoływana ręcznie. Aparaty cyfrowe zmieniły ten sposób działania, wykorzystując matrycę zamiast kliszy. Światło podobnie pada na matrycę, ale zamiast chemicznego i trwałego wypalania obrazu, maleńki układ scalony oblicza, na ile światła wystawiony jest każdy piksel i przekształca te wartości na szereg liczb, które później tworzą obraz.

Oznacza to, że aparaty cyfrowe zawsze wykonywały jakąś formę „obliczeń”. Jednak termin „fotografia obliczeniowa” zyskał popularność w głównym nurcie około 2016 roku, głównie dzięki pracy Marca Levoya w Google i jego pracy nad algorytmami wysokiego zakresu dynamiki (HDR) . Jednym z największych wyzwań w fotografii jest dokładne uchwycenie obrazów o dużej zmienności poziomów światła, a w aparatach mierzy się to zakresem dynamiki, czyli zakresem jasności od najjaśniejszych do najciemniejszych części, jaki aparat może uchwycić na jednym zdjęciu. W konsekwencji obraz HDR to taki, który został przetworzony w celu uzyskania jak największego zakresu dynamiki. Podczas gdy smartfony – a nawet zwykłe aparaty – mogły robić zdjęcia HDR już od dłuższego czasu, Marc i jego zespół opracowali algorytm, dzięki któremu od momentu otwarcia aplikacji aparatu automatycznie zaczynała ona robić zdjęcia w tle. Za każdym razem, gdy nacisnąłeś spust migawki, aparat przestawał robić zdjęcia, robił ostatnie kilka klatek i łączył je w jeden „superobraz”. Rezultaty były nie tylko oczywiste, ale powszechnie chwalone za lepszą szczegółowość, niższy poziom szumów i, owszem, większy zakres dynamiki. Jednocześnie, ponieważ przetwarzanie to zostało wykonane po zrobieniu zdjęcia, obraz w wizjerze nie do końca odpowiadał ostatecznemu wynikowi i służył raczej jako przybliżenie.

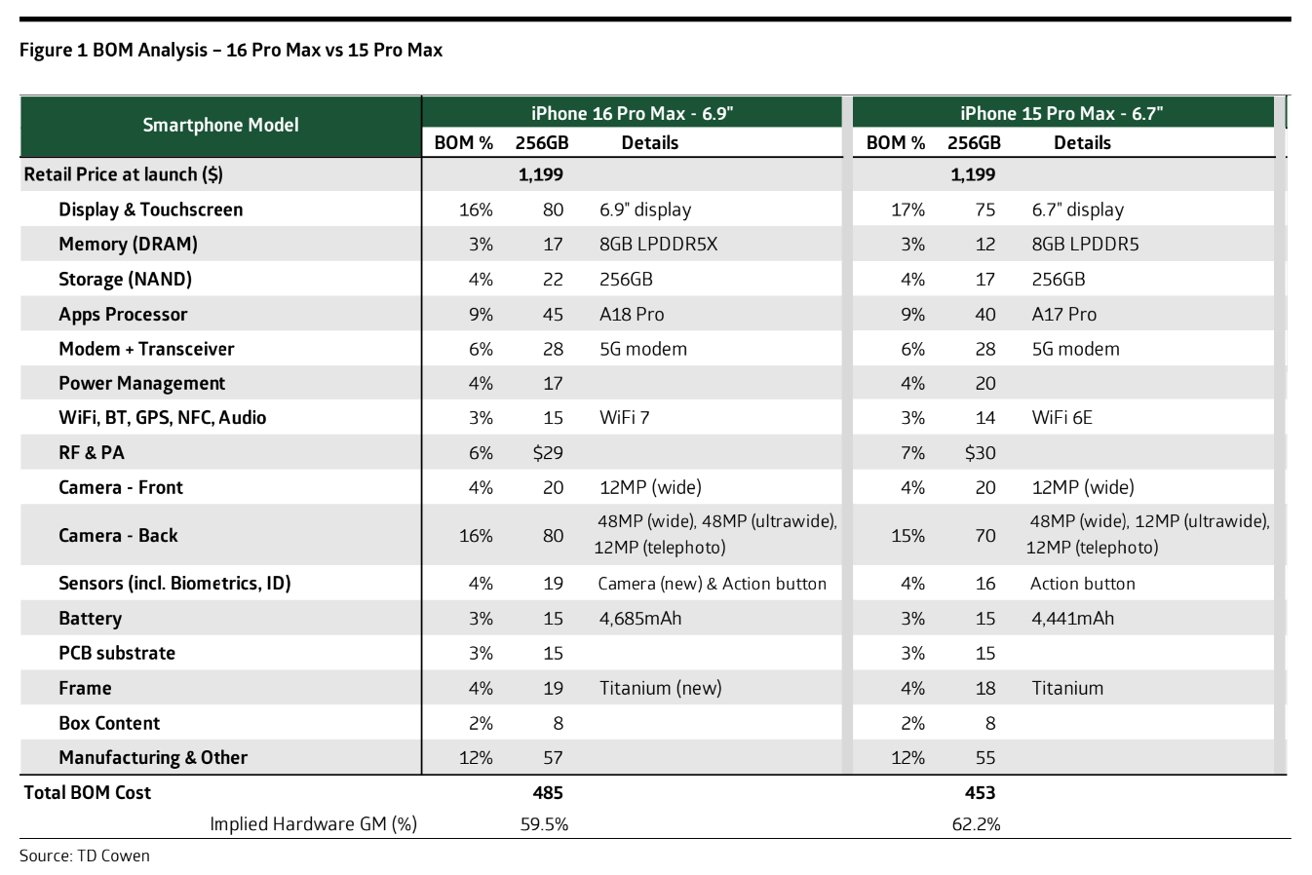

Można zapytać, po co to całe przetwarzanie, skoro tradycyjni producenci aparatów, tacy jak Sony i Canon, mogliby osiągać lepsze rezultaty, w mniejszym stopniu polegając na oprogramowaniu. Otóż, aparaty w smartfonach są stosunkowo tanie. Można się spierać, że urządzenie, które może kosztować ponad tysiąc euro, jest „tanie”, ale warto pamiętać, że aparat wcale nie jest najdroższym elementem telefonu. Według TD Cowena , matryce aparatu w iPhonie 16 stanowią mniej niż 20% kosztu części, i to obejmuje wszystkie trzy aparaty, a nie tylko ten główny.

Porównanie materiałów użytych w iPhone 16 i 15.

(Zdjęcie pochodzi od TD Cowena i Apple Insider.)

Porównaj to z tradycyjnymi aparatami i obiektywami o jednym przeznaczeniu, których cena może łatwo wynieść tysiące dolarów, a zobaczysz, że matryca aparatu w Twoim telefonie jest niezwykle mała i rzeczywiście tania.

Aby zniwelować różnice między tradycyjnymi aparatami a aparatami w telefonach, producenci musieli uciec się do sztuczek, takich jak wspomniane wcześniej łączenie zdjęć HDR, tryb nocny, dynamiczne ustawienia temperatury barwowej itp. Pozostaje jednak pytanie, dlaczego tak nagle wzrosło przekonanie, że zdjęcia stają się gorsze?

Znalazłem się między młotem a kowadłem.

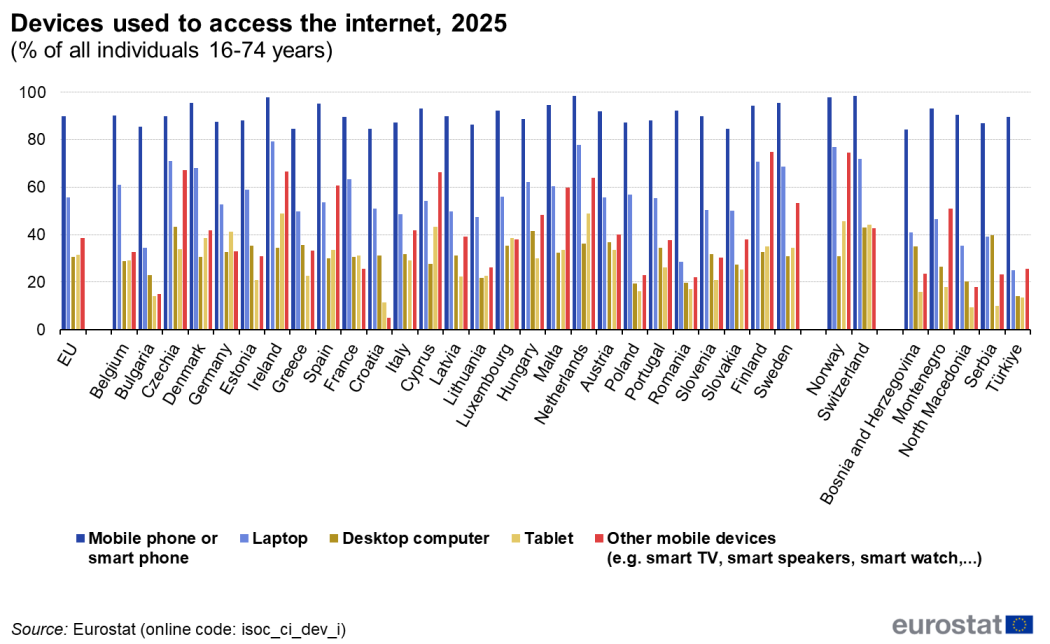

Kluczowym czynnikiem, który należy wziąć pod uwagę, jest baza użytkowników. Kiedy Sony produkuje aparat z wyższej półki, ma na myśli niezwykle niszową grupę demograficzną, grupę osób, którym może zaufać i która nauczy się, jak najlepiej korzystać z produktu. Kiedy Apple lub Google wypuszczają smartfon, muszą sprostać wymaganiom grupy ludzi z różnych kultur, klas społeczno-ekonomicznych i pokoleń – krótko mówiąc, wszystkich. Smartfony są tak powszechne, że według raportu Eurostatu w wielu krajach UE niemal 100% osób w wieku 16–74 lat korzysta z niego w celu uzyskania dostępu do Internetu.

Wykres porównujący typy urządzeń wykorzystywanych do dostępu do Internetu w UE, pogrupowane według krajów.

Oznacza to, że Twój aparat w telefonie musi być najlepszy dla 16-letniego licealisty, który robi zdjęcia tablicy podczas lekcji, dla Twoich dziadków, aby uwiecznić ich wakacje, dla Twoich rodziców, aby zrobić rodzinne zdjęcia podczas świąt, a w końcu dla Ciebie, aby ułatwić Ci codzienne funkcjonowanie. Musi działać zawsze i o każdej porze, nawet w typowo trudnych sytuacjach, takich jak zdjęcia podświetlone od tyłu czy zdjęcia nocne.

Mówiąc wprost, nie da się wyedukować tak dużej bazy użytkowników, co ogranicza producentów, którzy muszą stworzyć aparat, który zrobi „najlepsze” zdjęcie, nawet jeśli robi je ktoś nieznający podstawowych zasad fotografii. Nie jest to zły cel, a wręcz przeciwnie – stanowi demokratyczny sposób na wzbudzenie zainteresowania fotografią.