Als je de afgelopen jaren actief bent geweest op sociale media, is het je misschien opgevallen dat je nieuwe telefoon slechtere foto's maakt dan je vorige. Of je nu op Instagram of TikTok zit, je vindt er gemakkelijk tutorials over "hoe je de slechte camerakwaliteit van je iPhone kunt verbeteren" of "hoe je de automatische bewerking van je iPhone kunt uitschakelen".

Kwaliteit is echter een zeer subjectief begrip, dus wat stoort mensen nu precies? Een veelgehoorde klacht is dat de voorbeeldfoto in de camera-app niet helemaal overeenkomt met het uiteindelijke resultaat, maar daar is een goede reden voor. Om die te begrijpen, moeten we even terug in de tijd.

Wat betekent het dat een foto niet alleen digitaal, maar ook computergestuurd is?

Traditioneel gebruikten fotografen filmcamera's met weinig tot geen digitale input. Licht reisde door een lens, viel even op een film en werd later handmatig ontwikkeld. Digitale camera's veranderden dit door een sensor in plaats van film te gebruiken. Licht valt op dezelfde manier op de sensor, maar in plaats van dat het beeld chemisch en permanent wordt vastgelegd, berekent een kleine chip hoeveel licht elke pixel ontvangt en vertaalt die waarden naar een reeks getallen die later een beeld vormen.

Dit wil zeggen dat digitale camera's altijd al een vorm van "berekening" hebben uitgevoerd. De term "computationele fotografie" werd echter pas rond 2016 algemeen bekend, grotendeels dankzij het werk van Marc Levoy bij Google en zijn onderzoek naar High Dynamic Range (HDR)-algoritmes . Een van de grootste uitdagingen in de fotografie is het nauwkeurig vastleggen van beelden met grote variaties in lichtniveaus. Camera's meten dit aan de hand van het dynamisch bereik, oftewel het bereik van helderheid van de lichtste tot de donkerste delen dat een camera in één opname kan vastleggen. Een HDR-afbeelding is dan ook een afbeelding die is bewerkt om een zo groot mogelijk dynamisch bereik te hebben. Hoewel smartphones – en zelfs gewone camera's – al een tijdje HDR-foto's kunnen maken, ontwikkelden Marc en zijn team een algoritme waarmee de camera-app, zodra je hem opende, automatisch foto's op de achtergrond begon te maken. Zodra je op de sluiterknop drukte, stopte de camera met fotograferen, maakte de laatste paar opnames en voegde deze samen tot één "superafbeelding". De resultaten waren niet alleen duidelijk zichtbaar, maar werden ook alom geprezen vanwege de betere details, de lagere ruis en, inderdaad, het grotere dynamische bereik. Omdat deze nabewerking na het maken van de foto plaatsvond, betekende dit tegelijkertijd dat het beeld in de zoeker niet exact overeenkwam met het uiteindelijke resultaat en meer een schatting was.

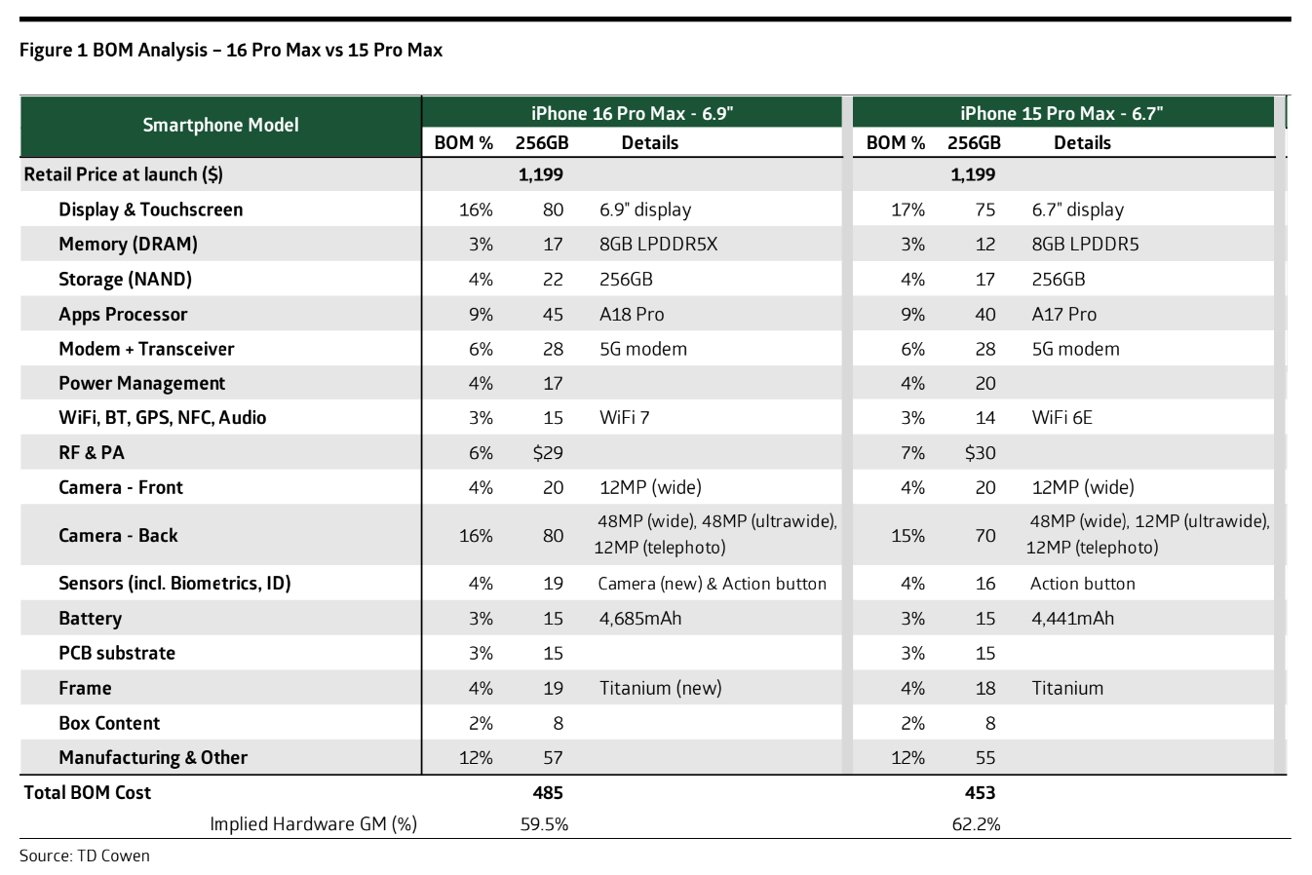

Je vraagt je misschien af waarom al die bewerkingen nodig zijn, terwijl traditionele camerafabrikanten zoals Sony en Canon betere resultaten zouden kunnen behalen met minder software. Welnu, dat komt doordat smartphonecamera's relatief goedkoop zijn. Je zou misschien de wenkbrauwen fronsen bij het idee dat een apparaat dat meer dan duizend euro kost "goedkoop" is, maar bedenk dat de camera absoluut niet het duurste onderdeel van je telefoon is. Volgens TD Cowen vertegenwoordigen de camerasensoren van een iPhone 16 minder dan 20% van de totale kosten, en dat geldt voor alle drie de camera's, niet alleen de hoofdcamera.

Vergelijking van de materiaallijst van de iPhone 16 en 15.

(Afbeelding van TD Cowen en Apple Insider.)

Vergelijk dit eens met traditionele camera's en lenzen voor specifieke doeleinden, die al snel duizenden dollars kosten, en je zult zien dat de sensor van je telefooncamera ongelooflijk klein en bovendien goedkoop is.

Om de kloof tussen traditionele camera's en telefooncamera's te overbruggen, hebben fabrikanten hun toevlucht moeten nemen tot trucs zoals de eerder genoemde HDR-samenvoeging, nachtmodus, dynamische kleurtemperatuurinstellingen, enzovoort. Maar de vraag blijft: waarom is de mening dat foto's slechter worden zo plotseling toegenomen?

In een lastig dilemma.

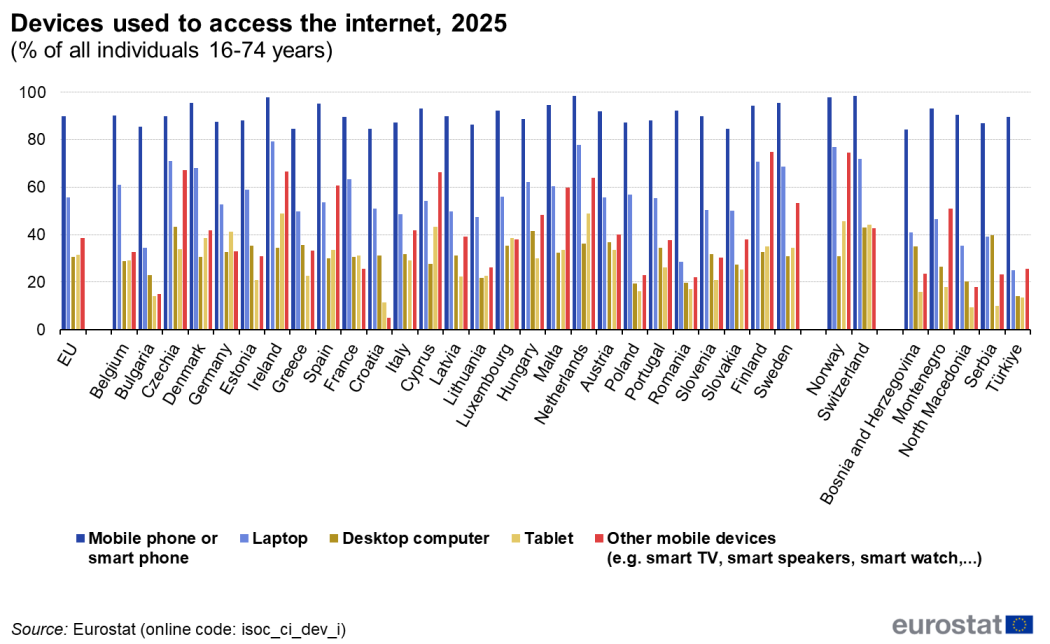

Een belangrijke factor om rekening mee te houden is de gebruikersgroep. Wanneer Sony een high-end camera maakt, richt het zich op een zeer specifieke doelgroep, een groep mensen waarvan het bedrijf erop kan vertrouwen dat ze het product optimaal zullen leren gebruiken. Wanneer Apple of Google een smartphone uitbrengen, moeten ze rekening houden met een groep mensen uit verschillende culturen, sociaaleconomische klassen en generaties – kortom, iedereen. Smartphones zijn zo wijdverbreid dat volgens een Eurostat-rapport In veel EU-landen gebruikt bijna 100% van de personen tussen 16 en 74 jaar een smartphone om toegang tot het internet te krijgen.

Grafiek met een vergelijking van de verschillende soorten apparaten die in de EU worden gebruikt om toegang tot internet te krijgen, gegroepeerd per land.

Dit betekent dat de camera van je telefoon de beste camera moet zijn voor een 16-jarige middelbare scholier die foto's maakt van het schoolbord tijdens de les, de beste camera voor je grootouders om hun vakantie vast te leggen, voor je ouders om familiefoto's te maken tijdens de feestdagen en tot slot voor jou om je dagelijkse leven te leiden. Hij moet altijd en overal werken, zelfs in traditioneel lastige situaties zoals foto's met tegenlicht of nachtopnamen.

Simpel gezegd is het onmogelijk om zo'n grote gebruikersgroep op te leiden. Fabrikanten zijn daarom beperkt in hun mogelijkheden en moeten een camera ontwikkelen die de "beste" foto maakt, zelfs wanneer deze wordt genomen door iemand die de basisregels van fotografie niet kent. Dit is niet per se een slecht doel, en het werkt bovendien als een democratische manier om interesse in fotografie te wekken.